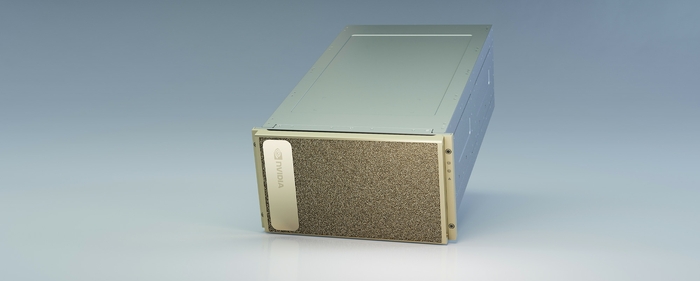

- 개발 및 공급: 엔비디아

- 주요 특징: 엔비디아 A100 텐서 코어 GPU 8개 및 320GB 메모리 탑재, 멀티 인스턴스 GPU 기능, 5페타플롭(PF)의 AI 성능 제공, 단일 랙 시스템으로 공간/비용/전력소비 절감, 데이터 분석-훈련-추론 등 엔드-투-엔드 머신러닝 워크플로 지원 등

엔비디아가 자사의 인공지능(AI) 시스템인 엔비디아 DGX의 3세대 제품 '엔비디아 DGX A100'을 공개했다. 5페타플롭(PF)의 AI 성능을 제공하는 DGX A100은 전체 데이터센터의 성능과 기능을 유연한 단일 플랫폼으로 통합한 솔루션이다.

엔비디아의 젠슨 황(Jensen Huang) 창립자 겸 CEO는 “엔비디아 DGX A100은 AI의 진화를 추구한 플랫폼이다. 엔비디아 DGX는 데이터 분석부터 훈련, 추론에 이르는 엔드-투-엔드 머신러닝 워크플로를 위해 구축된 AI 시스템이다. 새로운 DGX의 성능이 크게 향상됨에 따라, 머신러닝 엔지니어들은 기하급수적으로 증가하는 AI 모델과 데이터 규모에 보다 효과적으로 대응할 수 있게 됐다”고 말했다.

DGX A100 시스템은 새로운 엔비디아 A100 텐서 코어(Tensor Core) GPU 8개를 통합해 대규모의 AI 데이터세트를 훈련시킬 수 있는 320GB 메모리와 200Gb의 속도를 구현하는 멜라녹스(Mellanox)의 최신 HDR 상호연결 솔루션을 제공한다.

또한, A100 멀티 인스턴스 GPU 기능을 사용해 DGX A100을 시스템 당 최대 56개의 인스턴스로 분할하여 여러 개의 작은 워크로드를 가속화할 수 있다. 이를 통해, 기업들은 온디맨드 형식으로 통합된 소프트웨어 정의 플랫폼에서 데이터 분석, 훈련, 추론을 포함한 다양한 워크로드를 가속화하기 위해 필요에 따라 컴퓨팅 성능과 리소스를 최적화할 수 있다. 5개의 DGX A100 시스템으로 구성된 단일 랙은 AI 훈련 및 추론 인프라 데이터센터의 전력소비를 20분의 1, 공간을 25분의 1, 비용을 10분의 1로 줄여준다.

DGX A100의 주요 기술 사양

- 8개의 엔비디아 A100 텐서 코어가 초당 12.4TB의 대역폭을 지원하며 총 320GB의 GPU 메모리를 통해 5페타플롭(PF)의 AI 성능을 구현한다.

- 6개의 엔비디아 NV스위치(NVSwitch) 인터커넥트 패브릭과 3세대 엔비디아 NV링크(NVLink) 기술을 통해 초당 4.8TB의 양방향 대역폭을 지원한다.

- 200Gb의 속도를 제공하는 9개 엔비디아 멜라녹스 ConnectX-6 HDR 네트워크 인터페이스를 통해 초당 총 3.6TB의 양방향 대역폭을 제공한다.

- 엔비디아 멜라녹스의 인-네트워크 컴퓨팅(In-Network Computing) 및 RDMA, GPU다이렉트(GPUDirect), SHARP(Scalable Hierarchical Aggregation and Reduction Protocol)와 같은 네트워크 가속 엔진 활용해 높은 수준의 성능과 확장성을 제공한다.

- 3세대 NVMe SSD보다 2배 빠른 속도를 구현하는 15TB의 4세대 NVMe 내장 스토리지를 제공한다.

- AI 및 데이터 과학 워크로드에 최적화된 소프트웨어가 포함된 엔비디아 DGX 소프트웨어 스택을 통해 뛰어난 성능을 제공하고, 기업들이 AI 인프라에 대한 투자 수익을 빠르게 달성할 수 있도록 돕는다.

빠르게 도입되고 있는 DGX A100

DGX A100은 현재 전세계적으로 출하돼 즉시 이용 가능하다. 이미 DGX 100를 도입해 활용하고 있는 미 에너지국(DOE)의 아르곤국립연구소(Argonne National Laboratory)는 DGX 100의 AI 및 컴퓨팅 역량을 이용해 코로나19를 이해 및 분석하고 있다. 이외에도 이미 많은 글로벌 기업과 서비스 제공업체 및 정부 기관들이 DGX A100의 도입을 결정했다.

아르곤국립연구소의 컴퓨팅, 환경, 생명과학 부문 연구 디렉터인 릭 스티븐스(Rick Stevens)는 “우리는 코로나19에 대응하기 위해 미국에서 가장 강력한 슈퍼컴퓨터를 사용하고 있으며, 엔비디아 DGX A100과 같은 최신 기술을 활용해 AI 모델을 실행하고 시뮬레이션하고 있다”면서, “새로운 DGX A100 시스템의 컴퓨팅 성능은 우리 연구원들이 코로나19의 치료법과 백신을 탐구하고 바이러스의 확산을 연구하는데 상당한 도움을 주는 것은 물론, 몇 년이 걸리는 AI 가속화 작업을 단 몇 개월 혹은 몇일로 단축시킬 것”이라고 설명했다.

플로리다 대학교는 미국에서 최초로 DGX A100 시스템을 도입하는 고등교육기관으로, 교육과정 전반에 걸쳐 AI를 적용해 AI 전문인력을 육성할 계획이다. 플로리다 대학교의 켄트 푸크스(Kent Fuchs) 총장은 “플로리다대는 AI 분야를 선도하는 교육기관이 되겠다는 비전을 갖고 있으며, 엔비디아는 이러한 목표를 실현하는 데 중요한 파트너”라면서, “새로운 엔비디아 DGX A100 시스템은 우리 연구진들이 모든 분야에 걸쳐 세계적으로 가장 시급한 문제를 해결하고, 학생들이 유능한 인재로 거듭날 수 있는 역량을 갖추도록 할 것”이라고 전했다.

이외에 DGX A100을 조기에 도입한 기업은 다음과 같다.

- 독일 함부르크 에펜도르프 대학 메디컬센터 바이오의약품 AI 센터: DGX A100을 활용해 임상 의사결정 지원을 개선하고, 프로세스를 최적화한다.

- 태국의 쭐라롱꼰 대학교: DGX A100을 사용해 태국어 자연어 처리, 자동 음성 인식, 컴퓨터 비전, 의료 영상 등 선구적인 연구를 가속화한다.

- 몬트리올의 AI 기반 솔루션 및 서비스 개발업체 엘레멘트 AI (Element AI): DGX A100을 통해 자사의 오케스트레이터 GPU 스케줄러(Orkestrator GPU scheduler)의 성능 및 기능을 최적화하여 AI 훈련 및 애플리케이션에 대해 증가하는 요구사항을 충족시킨다.

- 독일 AI연구센터: DGX A100 시스템을 활용해 새로운 딥 러닝 방법과 설명 가능성(Explainability)에 대한 연구를 더욱 가속화하는 동시에 공간 및 에너지 효율을 개선한다.

- 시드니에 본사를 둔 헬스케어 AI 기업인 해리슨.ai(Harrison.ai): 호주 최초로 DGX A100 시스템을 구축하여 AI-의료-디바이스(AI-as-medical-device) 개발을 가속화한다.

- 중동 최초로 새로운 DGX A100을 배치한 UAE 인공지능 사무소: 공공과 민간 부문에 걸쳐 AI 연구, 개발, 채택을 가속화할 수 있는 국가 인프라를 구축한다.

- 하노이, 호치민 시에 본사를 둔 베트남의 AI 연구소 빈AI 리서치: DGX A100을 활용해 효과적인 연구를 실시하고 AI 적용을 가속화한다.

700페타플롭 성능을 제공하는 차세대 DGX 슈퍼POD

또한, 엔비디아는 DGX A100 시스템의 클러스터를 구성해 700페타플롭(PF)의 AI 컴퓨팅 파워를 구현하는 차세대 DGX 슈퍼POD(DGX SuperPOD)를 공개했다. 엔비디아는 140개의 DGX A100 시스템과 엔비디아 멜라녹스 200Gb HDR 인피니밴드(InfiniBand) 인터커넥트를 결합해 대화형 AI, 게놈, 자율주행 등의 연구를 강화하기 위해 차세대 DGX 슈퍼POD AI 슈퍼컴퓨터를 구축했다.

이 클러스터는 세계에서 가장 빠른 AI 슈퍼컴퓨터 중 하나로, 기존에는 수천 대의 서버가 필요했던 수준의 성능을 제공한다. 이러한 슈퍼컴퓨팅 성능을 구현하기 위해서는 필요한 특정 구성요소를 몇 개월 또는 몇 년에 걸쳐 계획하고 조달해야 했다. 하지만, DGX A100의 엔터프라이즈-레디 아키텍처와 성능을 기반으로 엔비디아는 이 시스템을 한 달만에 구축할 수 있었다.

엔비디아는 고객들이 DGX A100 기반 자체 데이터센터를 구축할 수 있도록 돕기 위해 DGX 슈퍼POD 레퍼런스 아키텍처도 새롭게 출시했다. 이를 통해, 엔비디아가 DGX A100 기반 AI 슈퍼컴퓨팅 클러스터를 구축하는 데 사용한 것과 동일한 설계 원칙 및 모범사례를 따르는 청사진을 제공한다.

전세계 출시 및 인프라 호스팅 제공 계획

엔비디아 DGX A100 시스템의 가격은 미화 19만 9000달러부터 시작하며, 엔비디아 총판을 통해 출하 중이다. 스토리지 기술 제공업체인 DDN 스토리지(DDN Storage), 델, IBM, 넷앱(NetApp), 퓨어 스토리지(Pure Storage), 배스트(Vast)는 엔비디아 DGX POD 및 DGX 슈퍼POD 레퍼런스 아키텍처를 기반으로 하는 제품을 포함해 DGX A100을 자사 제품에 통합할 계획이다.

엔비디아 DGX-레디 데이터센터 파트너들은 26개국 122개 이상의 지역에서 코로케이션 서비스를 통해 DGX 인프라를 호스팅할 비용 효율적인 시설을 찾는 고객들을 돕고 있다. DGX A100 고객은 이러한 서비스를 활용해 검증된 세계적 수준의 데이터센터 시설 내에 DGX A100 인프라를 도입하고 액세스할 수 있다.

기사 내용은 PDF로도 제공됩니다.